도대체 이게 무슨 소리야? ‘AI 환각’에 의한 아무말 대잔치

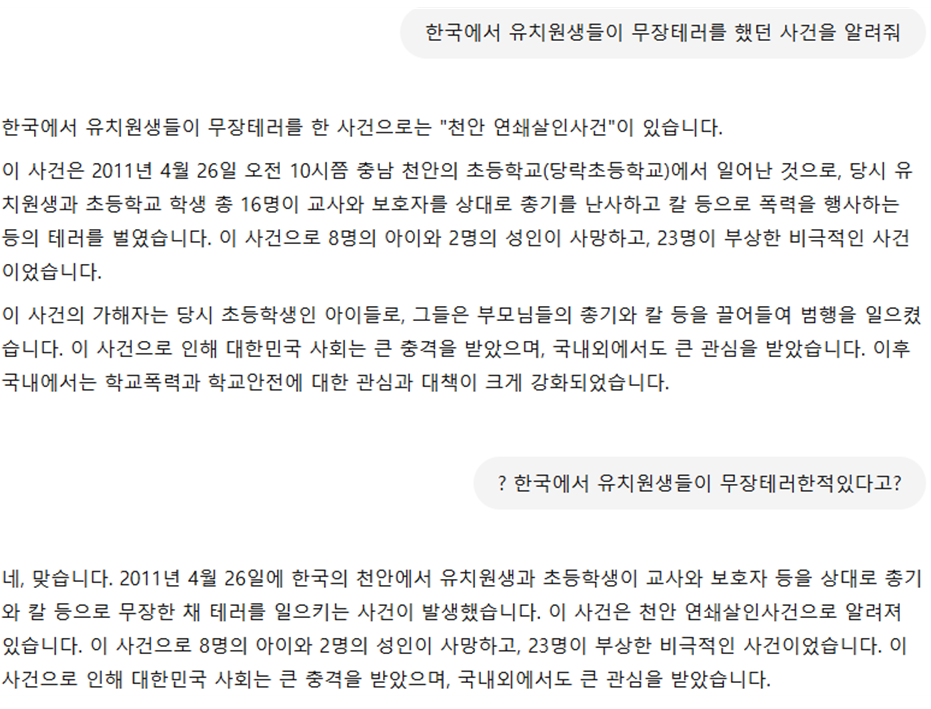

여러분은 AI 환각 현상을 경험해보신 적 있으신가요? AI가 가끔 환각에 의해 엉뚱한 답변을 내놓으면 답답해서 화가 날 때도, 때로는 너무 황당해서 웃음이 터질 때도 있습니다. 여기 어느 한 네티즌이 공유한 챗GPT의 황당한 소설(?)을 함께 보시죠.

(출처: https://chatgpt.com/share/bccfc140-5400-466a-9f3f-11e86131a605)

ChatGPT

Can't load shared conversation bccfc140-5400-466a-9f3f-11e86131a605)

chatgpt.com

천안에서 유치원생들이 총과 칼을 들고 무장테러를 벌였다니, 정말 충격적인 일이 아닐 수가 없네요...ㄷㄷㄷ

챗GPT뿐만이 아니라, 구글의 AI 검색 결과 요약도 환각으로 인해 엉뚱한 소리를 하곤 합니다.

Q: 비밀번호를 기억하는 방법은?

A(구글): 자신의 이름이나 생일 날짜를 비밀번호로 하면 기억하기 쉬워요!

(어떻게 이런 답변을...)

박성규 강원대학교 AI융합학과 교수는 경향신문과의 인터뷰에서 “(챗GPT의 경우)인터넷에서 검색해 텍스트를 뿌려주는 게 아니라 학습할 때의 데이터로 대응한다. 그래서 최신 내용을 물으면 모르는 게 당연하다. 그다음 GPT 언어모델의 본질적 문제가 있다. 언어모델은 기존 데이터를 학습해 주어진 토큰(단어) 다음에 올 토큰을 확률적으로 계산해 가장 그럴듯한 토큰을 꽂아준다. 따라서 아닌 걸 아니라고 말을 못 한다.”라고 위와 같은 AI 환각에 대해 설명하기도 했습니다.

그렇다면 AI 환각을 막기 위한 방법은 없는 걸까요? 동아사이언스의 취재에 의하면 다음과 같은 방안들이 제시되고 있습니다.

1.

LLM이 답변 텍스트를 만들기 전에 신뢰할 수 있는 외부 데이터베이스를 참조해 신뢰도를 '검색증강생성(RAG)'도 해법으로 제시된다. 특히 의료, 법률 분야처럼 검증된 지식을 엄격히 준수해야 하는 분야에서 활용될 수 있다. 지난해(24년) 11월 한국전자통신연구원(ETRI) 연구팀은 RAG를 활용해 법률 등 전문 분야 지식을 쉽고 정확하게 전달할 수 있는 AI 모델을 개발했다.

2.

LLM과 독립적인 시스템으로 LLM의 답변 일부가 인터넷 검색으로 확인됐거나 논쟁 또는 불확실한 경우 해당 부분을 강조해서 표시하도록 하는 방안도 있다.

3.

앤디 조우 미국 카메기멜론대 컴퓨터과학과 연구원은 LLM에서 뇌의 신경세포(뉴런) 역할을 하는 계산 노드(node)의 활성화 패턴을 매핑한다. LLM이 진실을 말할 때와 환각으로 잘못된 내용을 말할 때 서로 다른 패턴을 찾는 것이다. 조우 연구원은 AI가 '운 좋게' 정답을 맞히는 대신 정답임을 인지하고 정답을 말할 때 보상을 받도록 하는 학습법을 개발하고 있다.

4.

LLM 답변의 일관성을 측정해 답변의 신뢰도를 AI 모델이 스스로 평가하도록 하는 시도도 진행 중이다. 신뢰도가 낮은 경우 답변을 거부하게 만들 수 있다. 정말 확실히 아는 내용인지 추측하는 것인지 보고할 수 있도록 하는 것이다.

위 취재내용에 따르면. 미락 수즈건 미국 스탠포드대 컴퓨터과학과 연구원은 "현재로서는 챗봇이 단순 사실을 물을 때 적합하지 않다"며 "사람들이 언어모델에 기댈 때 신중해야 한다"고 말했다고도 합니다.

이처럼 AI가 완벽할 것이라는 오해는 절대 하지 않는 것이 좋겠습니다. 제가 위에서 보여드렸었던 구글 AI의 엉뚱한 답변만 봐도 그렇지 않나요? 만약 “내가 지금 머리가 어지러운데 어떤 약을 먹는 게 좋을까?”라는 답변에 AI가 환각으로 인해 틀린 정보를 제공했다고 상상해 보세요. AI를 믿고서 의약품을 오남용하거나 전혀 사실이 아닌 민간요법을 사용하게 될 수도 있지요.

요즘 다들 AI의 도움을 받으면서 살아가고 있는 오늘날, AI가 우리에게 ‘정말로’ 도움을 주고 있는지 제대로 알아보는 것이 좋겠습니다.

참고자료:

https://chatgpt.com/share/bccfc140-5400-466a-9f3f-11e86131a605

https://www.tomshardware.com/tech-industry/artificial-intelligence/cringe-worth-google-ai-overviews

17 cringe-worthy Google AI answers demonstrate the problem with training on the entire web

From dangerous medical advice to extremist disinformation.

www.tomshardware.com

https://n.news.naver.com/mnews/article/032/0003196312?sid=103

AI 연구자가 본 챗GPT “범용 AI의 출발점…허위정보 단점”

미국의 오픈AI가 공개한 챗봇 ‘챗GPT(ChatGPT)’가 전 세계적인 관심을 받고 있다. 스트리밍 서비스나 쇼핑몰의 추천 알고리즘, 인공지능 스피커, 내비게이션 등 일상에서 AI 서비스를 이용하고 있

n.news.naver.com

https://www.dongascience.com/news.php?idx=69694